Online first

Bieżący numer

Archiwum

O czasopiśmie

Polityka etyki publikacyjnej

System antyplagiatowy

Instrukcje dla Autorów

Instrukcje dla Recenzentów

Rada Redakcyjna

Komitet Redakcyjny

Recenzenci

Wszyscy recenzenci

2025

2024

2023

2022

2021

2020

2019

2018

2017

2016

Kontakt

Bazy indeksacyjne

Klauzula przetwarzania danych osobowych (RODO)

Wybór Redakcji

PRACA ORYGINALNA

Poziom zaufania do sztucznej inteligencji w medycynie-perspektywa osób spoza środowiska medycznego

1

Collegium Medicum im. dr Władysława Biegańskiego, Jan Długosz University, Częstochowa, Poland

2

Department of Pathomorphology in Zabrze, Medical University of Silesia, Katowice, Poland

3

Department of Pathomorphology, Faculty of Medical Sciences, Zabrze, Poland

Zaznaczeni autorzy mieli równy wkład w przygotowanie tego artykułu

Autor do korespondencji

Julia Faustyna Bednarek

Collegium Medicum im. dr Władysława Biegańskiego, Jan Długosz University, Armii Krajowej 13/15, 42–200 Częstochowa, Poland

Collegium Medicum im. dr Władysława Biegańskiego, Jan Długosz University, Armii Krajowej 13/15, 42–200 Częstochowa, Poland

SŁOWA KLUCZOWE

DZIEDZINY

STRESZCZENIE

Wprowadzenie i cel:

Celem badania było określenie poziomu zaufania osób spoza środowiska medycznego do sztucznej inteligencji (AI) w ochronie zdrowia oraz identyfikacja czynników wpływających na akceptację lub odrzucenie tej technologii.

Materiał i metody:

Badaniem objęto 817 osób niezwiązanych zawodowo ani naukowo z medycyną. Zastosowano metodę sondażu diagnostycznego z wykorzystaniem kwestionariusza ankiety składającego się z 33 pytań zamkniętych i wielokrotnego wyboru. Pytania dotyczyły wiedzy, doświadczeń, opinii oraz obaw związanych z wykorzystaniem AI w diagnostyce i leczeniu. Dane zbierano w formie papierowej oraz online w okresie od marca do czerwca 2025 roku.

Wyniki:

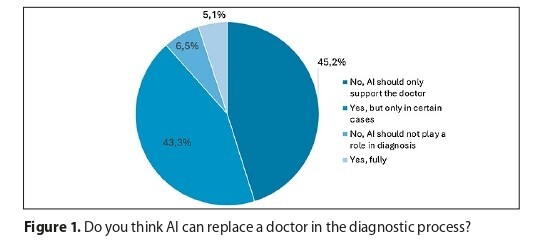

Duża część badanych (45,2%) postrzega AI jako narzędzie wspierające lekarza, a nie jako samodzielnego decydenta. Najczęściej wskazywane obszary zastosowania AI to radiologia, diagnostyka i personalizacja terapii. Poziom zaufania do AI oceniany był jako umiarkowany. Neutralną postawę wobec tej technologii przyjęło 63,1% respondentów. Kluczowe dla wzrostu zaufania okazały się audyty, certyfikacja systemów, współpraca AI z lekarzem i przejrzystość decyzji. Zdecydowana większość ankietowanych (92,6%) oczekuje, iż pacjent będzie miał prawo do informacji o użyciu AI, a 65,7% podkreśla niezastąpioną rolę empatii lekarza. Główne obawy dotyczą błędnych diagnoz (84%), braku kontroli lekarza nad AI (69,6%) oraz trudności w przypisaniu odpowiedzialności prawnej (65,4%).

Wnioski:

Osoby spoza środowiska medycznego akceptują obecność AI w medycynie, jednak wyłącznie jako narzędzia wspierającego lekarza. Warunkiem akceptacji są przejrzystość, regulacje prawne, edukacja pacjentów i lekarzy oraz zachowanie relacji lekarz–pacjent.

Celem badania było określenie poziomu zaufania osób spoza środowiska medycznego do sztucznej inteligencji (AI) w ochronie zdrowia oraz identyfikacja czynników wpływających na akceptację lub odrzucenie tej technologii.

Materiał i metody:

Badaniem objęto 817 osób niezwiązanych zawodowo ani naukowo z medycyną. Zastosowano metodę sondażu diagnostycznego z wykorzystaniem kwestionariusza ankiety składającego się z 33 pytań zamkniętych i wielokrotnego wyboru. Pytania dotyczyły wiedzy, doświadczeń, opinii oraz obaw związanych z wykorzystaniem AI w diagnostyce i leczeniu. Dane zbierano w formie papierowej oraz online w okresie od marca do czerwca 2025 roku.

Wyniki:

Duża część badanych (45,2%) postrzega AI jako narzędzie wspierające lekarza, a nie jako samodzielnego decydenta. Najczęściej wskazywane obszary zastosowania AI to radiologia, diagnostyka i personalizacja terapii. Poziom zaufania do AI oceniany był jako umiarkowany. Neutralną postawę wobec tej technologii przyjęło 63,1% respondentów. Kluczowe dla wzrostu zaufania okazały się audyty, certyfikacja systemów, współpraca AI z lekarzem i przejrzystość decyzji. Zdecydowana większość ankietowanych (92,6%) oczekuje, iż pacjent będzie miał prawo do informacji o użyciu AI, a 65,7% podkreśla niezastąpioną rolę empatii lekarza. Główne obawy dotyczą błędnych diagnoz (84%), braku kontroli lekarza nad AI (69,6%) oraz trudności w przypisaniu odpowiedzialności prawnej (65,4%).

Wnioski:

Osoby spoza środowiska medycznego akceptują obecność AI w medycynie, jednak wyłącznie jako narzędzia wspierającego lekarza. Warunkiem akceptacji są przejrzystość, regulacje prawne, edukacja pacjentów i lekarzy oraz zachowanie relacji lekarz–pacjent.

Introduction and objective:

The aim of this study was to determine the level of trust among people outside the medical community toward AI (AI) in health care, and to identify factors influencing the acceptance or rejection of this technology.

Material and methods:

The study included 817 respondents with no professional or academic ties to medicine. A diagnostic survey method was used, employing a questionnaire consisting of 33 closed and multiple-choice questions. The questions addressed knowledge, experience, opinions, and concerns regarding the use of AI in diagnostics and treatment. Data were collected both in paper form and online between March – June 2025

Results:

A large proportion of respondents perceive AI as a tool supporting physicians (45.2%), rather than an independent decision maker. The most commonly indicated areas of application were radiology, diagnostics, and therapy personalization. The level of trust in AI was rated as moderate with 63.1% of respondents expressing a neutral attitude. Key factors for building trust included audits, system certification, collaboration between AI and physicians, and decision transparency. The vast majority of respondents (92.6%) expect patients’ right to be informed about AI usage, while 65.7% emphasize the irreplaceable role of physician empathy. The main concerns involved diagnostic errors (84%), lack of physician oversight (69.6%), and difficulties assigning legal responsibility (65.4%).

Conclusions:

People outside the medical community accept the presence of AI in medicine, but only as a tool supporting the physician. Conditions for acceptance include transparency, legal regulations, education for both patients and doctors, and maintaining the doctor-patient relationship.

The aim of this study was to determine the level of trust among people outside the medical community toward AI (AI) in health care, and to identify factors influencing the acceptance or rejection of this technology.

Material and methods:

The study included 817 respondents with no professional or academic ties to medicine. A diagnostic survey method was used, employing a questionnaire consisting of 33 closed and multiple-choice questions. The questions addressed knowledge, experience, opinions, and concerns regarding the use of AI in diagnostics and treatment. Data were collected both in paper form and online between March – June 2025

Results:

A large proportion of respondents perceive AI as a tool supporting physicians (45.2%), rather than an independent decision maker. The most commonly indicated areas of application were radiology, diagnostics, and therapy personalization. The level of trust in AI was rated as moderate with 63.1% of respondents expressing a neutral attitude. Key factors for building trust included audits, system certification, collaboration between AI and physicians, and decision transparency. The vast majority of respondents (92.6%) expect patients’ right to be informed about AI usage, while 65.7% emphasize the irreplaceable role of physician empathy. The main concerns involved diagnostic errors (84%), lack of physician oversight (69.6%), and difficulties assigning legal responsibility (65.4%).

Conclusions:

People outside the medical community accept the presence of AI in medicine, but only as a tool supporting the physician. Conditions for acceptance include transparency, legal regulations, education for both patients and doctors, and maintaining the doctor-patient relationship.

REFERENCJE (30)

1.

Gille F. What we talk about when we talk about trust: theory of trust for AI in healthcare. Intelligence-Based Medicine. 2020;1–2:100001. https://doi.org/10.1016/j.ibme....

2.

Cingolani M, et al. AI and digital medicine for integrated home care services in Italy: opportunities and limits. Front Public Health. 2023;10:1095001. https://doi.org/10.3389/fpubh.....

3.

DeCamp M, Tilburt JC. Why we cannot trust AI in medicine. Lancet Digit Health. 2019;1(8):e390. https://doi.org/10.1016/s2589-....

4.

Roy E, Malafa S, Adwer LM, et al. AI in healthcare: medical students’ perspectives on balancing innovation, ethics, and patient-centered care. Int J Med Students. 2025;13(1):9–16. https://doi.org/10.5195/ijms.2....

5.

Hatherley JJ. Limits of trust in medical AI. J Med Ethics. 2020;46(7):478–481. https://doi.org/10.1136/medeth....

6.

Poon AIF, Sung JJY. Opening the black box of AI-medicine. J Gastroenterol Hepatol. 2021;36(3):581–584. https://doi.org/10.1111/jgh.15....

7.

Deshpande NM, et al. Explainable AI – a new step towards the trust in medical diagnosis with AI frameworks: a review. Comput Model Eng Sci. 2022;133(2):395–418.

8.

Yang Q, et al. Harnessing biomedical literature to calibrate clinicians’ trust in AI decision support systems. Proc ACM CHI Conf Hum Factors Comput Syst. 2023. https://doi.org/10.1145/354454....

9.

Shevtsova D, et al. Trust in and acceptance of AI applications in medicine: mixed methods study. JMIR Hum Factors. 2024;11(1):e47031.

10.

Weiner EB, et al. Ethical challenges and evolving strategies in the integration of AI into clinical practice. PLOS Digit Health. 2025;4(4):e0000810. https://doi.org/10.1371/journa....

11.

Chen C, Cui Z. Impact of AI-assisted diagnosis on American patients’ trust in and intention to seek help from health care professionals: randomized, web-based survey experiment. J Med Internet Res. 2025;27:e66083.

12.

Nickel PJ. Trust in medical AI: a discretionary account. Ethics Inf Technol. 2022; 24(1): 1–12. https://doi.org/10.1007/s10676....

13.

Burgess ER, et al. Healthcare AI treatment decision support: design principles to enhance clinician adoption and trust. Proc ACM CHI Conf Hum Factors Comput Syst. 2023; https://doi.org/10.1145/354454....

14.

Roski J, et al. Enhancing trust in AI through industry self-governance. J Am Med Inform Assoc. 2021;28(7):1582–1590. https://doi.org/10.1093/jamia/....

15.

Tucci V, Saary J, Doyle TE. Factors influencing trust in medical AI for healthcare professionals: a narrative review. J Med Artif Intell. 2022;5:1–12.

16.

Michel J, et al. Charting a new course in healthcare: early-stage AI algorithm registration to enhance trust and transparency. npj Digit Med. 2024;7(1):11104. https://doi.org/10.1038/s41746....

17.

Sheliemina N. The use of AI in medical diagnostics: opportunities, prospects and risks. Health Econ Manag Rev. 2024;5(2):104–124.

18.

Hallowell N, Badger S, Sauerbrei A, et al. I don’t think people are ready to trust these algorithms at face value: trust and the use of machine learning algorithms in the diagnosis of rare disease. BMC Med Ethics. 2022;23:112. https://doi.org/10.1186/s12910....

19.

Meyer A, et al. Comparison of ChatGPT, Gemini, and Le Chat with physician interpretations of medical laboratory questions from an online health forum. Clin Chem Lab Med. 2024. https://doi.org/10.1515/cclm-2....

20.

Afroogh S, et al. Trust in AI: progress, challenges, and future directions. Humanit Soc Sci Commun. 2024;11(1):1–13. https://doi.org/10.1057/s41599....

21.

George ASH, Shahul A, George AS. AI in medicine: a new way to diagnose and treat disease. Partners Univ Int Res J. 2023;2(3):246–259.

22.

Ferrario A, et al. Trust does not need to be human: it is possible to trust medical AI. J Med Ethics. 2020;46(12):856–862. https://doi.org/10.1136/medeth....

23.

Juravle G, et al. Trust in AI for medical diagnoses. Prog Brain Res. 2020;253:263–282.

24.

Robertson C, et al. Diverse patients’ attitudes towards AI (AI) in diagnosis. PLOS Digit Health. 2023;2(5):e0000237.

25.

Nundy S, Montgomery T, Wachter RM. Promoting trust between patients and physicians in the era of AI. JAMA. 2019;322(6):497–498.

26.

Esmaeilzadeh P, Mirzaei T, Dharanikota S. Patients’ perceptions toward human–AI interaction in health care: experimental study. J Med Internet Res. 2021;23(11):e25856.

27.

Foresman G, et al. Patient perspectives on AI in health care: focus group study for diagnostic communication and tool implementation. J Particip Med. 2025;17(1):e69564.

28.

Tun HM, et al. Trust in AI–based clinical decision support systems among health care workers: systematic review. J Med Internet Res. 2025;27:e69678.

29.

Fan W, Liu J, Zhu S, et al. Investigating the impacting factors for the healthcare professionals to adopt AI-based medical diagnosis support system (AIMDSS). Ann Oper Res. 2020;294:567–592. https://doi.org/10.1007/s10479....

30.

Smoła P, et al. Attitudes toward AI and robots in healthcare in the general population: A qualitative study. Frontiers in Digital Health. 2025;7:1458685. https://doi.org/10.3389/fdgth.....

Udostępnij

ARTYKUŁ POWIĄZANY

Przetwarzamy dane osobowe zbierane podczas odwiedzania serwisu. Realizacja funkcji pozyskiwania informacji o użytkownikach i ich zachowaniu odbywa się poprzez dobrowolnie wprowadzone w formularzach informacje oraz zapisywanie w urządzeniach końcowych plików cookies (tzw. ciasteczka). Dane, w tym pliki cookies, wykorzystywane są w celu realizacji usług, zapewnienia wygodnego korzystania ze strony oraz w celu monitorowania ruchu zgodnie z Polityką prywatności. Dane są także zbierane i przetwarzane przez narzędzie Google Analytics (więcej).

Możesz zmienić ustawienia cookies w swojej przeglądarce. Ograniczenie stosowania plików cookies w konfiguracji przeglądarki może wpłynąć na niektóre funkcjonalności dostępne na stronie.

Możesz zmienić ustawienia cookies w swojej przeglądarce. Ograniczenie stosowania plików cookies w konfiguracji przeglądarki może wpłynąć na niektóre funkcjonalności dostępne na stronie.